מה חדש בשכונה של הבינה מלאכותית

המרת כלים בעזרת A.I suno

וזה לא ניגמר פה

שלבים שלב אחרי שלב SUNO

איך עושים את זה ….תרגיל כיתה עצמי

קישור : https://www.topmediai.com/

העשרה איך מפתחים תוכנה לשינוי קול

מבוסס על שילוב של מספר מודלים מתקדמים של בינה מלאכותית, בעיקר בתחומי ה-Audio Generation וה-Voice Cloning.

כדי לפתח יכולת כזו מאפס, משתמשים בדרך כלל בארכיטקטורות הבאות:

1. מודלי שיבוט קול (Voice Cloning / Zero-Shot TTS)

הלב של המערכת הוא היכולת לקחת דגימת קול קצרה ולהפיק ממנה "טביעת קול" (Voice Embedding). מודלים נפוצים בתחום זה כוללים:

-

RVC (Retrieval-based Voice Conversion): אחד המודלים הפופולריים והיעילים ביותר כיום להמרת קול. הוא מאפשר "להלביש" קול של אדם אחד על ביצוע של אדם אחר (או על מלודיה קיימת) תוך שמירה על האינטונציה.

-

Tortoise TTS או Vall-E: מודלים המבוססים על ארכיטקטורת Transformer (בדומה ל-GPT) שנועדו ליצור דיבור שנשמע אנושי מאוד מדגימה קצרה בלבד.

2. מודלי גנרציה של מוזיקה (Music Generative Models)

Suno עצמה משתמשת במודל קנייני (כנראה ממשפחת ה-Diffusion או ה-Autoregressive Transformers) שיודע להפוך טקסט לאודיו מורכב הכולל כלי נגינה, קצב ושירה.

-

AudioLDM / MusicLM: מודלים מבוססי Diffusion שמייצרים סאונד מתוך "רעש" על בסיס תיאור טקסטואלי.

-

Jukebox (של OpenAI): מודל ישן יותר אך פורץ דרך שהשתמש ב-VQ-VAE כדי ליצור שירים שלמים כולל שירה.

3. ארכיטקטורת המערכת (שלבים בייצור)

כדי לדמות את מה שרואים בסרטון, התהליך הטכני נראה כך:

-

Encoder: דגימת הקול של המשתמש עוברת דרך מקודד שהופך אותה לוקטור מספרי שמייצג את המאפיינים הייחודיים של הקול (צרידות, טון, מבטא).

-

Conditioning: הוקטור הזה מוזן למודל הגנרטיבי (ה-LLM של המוזיקה) כ"אילוץ". המודל מונחה לייצר את תדרים השירה כך שיתאימו לוקטור הקול הזה.

-

Vocoder: שלב סופי שבו המידע הדיגיטלי הופך לגל קול (Waveform) איכותי שניתן לשמוע.

4. טכנולוגיות משלימות

-

Biometric Verification: כפי שרואים בסרטון [03:50], המערכת דורשת מהמשתמש להקליט משפט ספציפי בזמן אמת כדי לוודא שזהו אכן הקול שלו ולא הקלטה של זמר מפורסם (הגנה מפני Deepfake).

-

Fine-tuning: בחלק מהמקרים, המערכת מבצעת "כיוונון עדין" מהיר של המודל על דגימת הקול הספציפית כדי להגיע לדיוק מקסימלי.

אם אתה מעוניין לנסות לפתח משהו דומה בעצמך, מומלץ להתחיל מחקירת פרויקטים בקוד פתוח כמו RVC-WebUI או ספריות כמו Coqui TTS.

העשרה

reinforcement learning

Reinforcement Learning (למידת חיזוק, או בקיצור RL) היא אחת משלוש הפרדיגמות המרכזיות של למידת מכונה (יחד עם למידה מונחית ולמידה בלתי מונחית).

בניגוד לשיטות אחרות שבהן המחשב מקבל דוגמאות מוכנות ("זה חתול", "זה כלב"), ב-RL המחשב לומד דרך ניסוי וטעייה. זהו תהליך שדומה מאוד לאופן שבו אנחנו מאלפים כלב או לאופן שבו ילד לומד ללכת: הוא מבצע פעולה, ואם התוצאה טובה הוא מקבל "פרס", ואם היא רעה – הוא מקבל "עונש" (או פשוט לא מקבל פרס).

המרכיבים המרכזיים של RL

כדי להבין איך זה עובד, נהוג להשתמש במודל שמורכב מחמישה אלמנטים:

הסוכן (Agent): ה"מוח" של המערכת. הישות שמקבלת החלטות (למשל: תוכנה שמשחקת שחמט או בקר של רחפן).

הסביבה (Environment): העולם שבו הסוכן פועל (למשל: לוח השחמט או חוקי הפיזיקה שבהם הרחפן טס).

מצב (State): תמונת מצב נוכחית של הסביבה (איפה הכלים על הלוח? מה הגובה של הרחפן?).

פעולה (Action): מה שהסוכן מחליט לעשות (להזיז רץ ל-C4, להגביר מהירות מנוע).

תגמול (Reward): ציון מספרי שהסוכן מקבל מהסביבה. המטרה של הסוכן היא למקסם את סך התגמולים לאורך זמן.

איך הלמידה מתבצעת בפועל?

הסוכן מתחיל לרוב בלי לדעת כלום על העולם. הוא מבצע פעולות אקראיות לחלוטין.

אם הוא מצליח (למשל: מנצח במשחק), הוא מקבל תגמול חיובי גבוה. המערכת "מחזקת" את סדרת הפעולות שהובילה לניצחון.

אם הוא נכשל (למשל: הרחפן מתרסק), הוא מקבל תגמול שלילי. המערכת לומדת להימנע מהפעולות הללו בעתיד.

האתגר הגדול ב-RL הוא בעיית הקרדיט המאוחר: לפעמים הסוכן עושה פעולה מצוינת בתחילת המשחק, אבל מקבל את הניצחון רק אחרי 50 צעדים. המודלים המתמטיים (כמו Q-Learning או Policy Gradients) יודעים לחשב אחורה איזה צעדים באמת תרמו להצלחה.

דוגמאות לשימוש ב-RL (שקרובות לתחומי העניין שלך):

רובוטיקה ורחפנים: במקום לתכנת באופן ידני כל תנועה של מנוע, נותנים לרחפן "סימולטור" ומגדירים לו מטרה (למשל: להגיע לנקודה X בלי להתנגד בקיר). הרחפן מנסה מיליוני פעמים בסימולציה עד שהוא לומד את הדרך האופטימלית לשלוט במנועים.

משחקי מחשב: המקרה המפורסם ביותר הוא AlphaGo, שהשתמש ב-RL כדי לנצח את אלוף העולם במשחק ה-"גו", שנחשב למורכב מדי עבור חישובים רגילים.

מערכות המלצה: אלגוריתמים של יוטיוב או טיקטוק משתמשים בגרסאות של RL כדי להבין איזה סרטון יגרום לך להישאר באפליקציה (התגמול שלהם הוא זמן הצפייה שלך).

הדילמה המרכזית: Exploration vs. Exploitation

זהו מושג קריטי ב-RL:

Exploitation (ניצול): לעשות את מה שהסוכן כבר יודע שעובד כדי לקבל פרס בטוח.

Exploration (חקירה): לנסות פעולה חדשה ולא מוכרת, אולי היא תוביל לפרס גדול בהרבה בעתיד.

באיזה שלב של הלימודים שלך ב-AI נתקלת במושג הזה? אולי כשבנית מודלים של ראייה ממוחשבת או שזה קשור לפרויקטים אחרים?

תרגיל – חזרה ANN CATEGORIAL הרץ

https://colab.research.google.com/drive/1GOrI6EjlxBIz7e51zrm2akOVYUFoxbh7?usp=sharing

תכונה פשוטה יותר

DOPPL

STEEZELY https://steezely.com/

https://steezely.com/?utm_source=chatgpt.com

תרגיל כיתה 1 : בינה מלאכותית עיצוב אופנה

- חפש באינטרנט \ צור בעזרת בינה מלאכותית אביזרי אופנה אופנה על רקע לבן שמאלות מכנסים חולצה לגבר או אישה מספר דגמים מאותו סוג מלבוש

- הורד דמות של גבר וגם דמות של אישה

- מדוד בגדים תכשטים ואביזירי אופנה בעזרת הביגוד שהורדתם

תרגיל כיתה לימוד עצמי 2 :

- מצא בעזרת בינה מלאכותית – אפליקציות ושירותים מובילים בתחום האיפור הווירטואלי

- מה התוכנות המובילות

- נסה אותם צור או העלה תמונה שלך או דמות אחרת ובצע בעזרת בינה מלאוכתית איפור ווירטואלי

תרגיל כיתה 3 : בינה מלאכותית עיצוב אופנה

1.הורד את תוכנת גוגל לטלפון לתרגול (לפי שיקולי הבטחה רלוונטיים )

2. צלם או העלה תמונה , העלה תמונה ל TRY ON בגד ובצע התאמה עלידי הבינה מלאכותית

תרגיל כיתה 4 : בינה מלאכותית עיצוב אופנה – מחקר

1.. בדוק איזה עוד תוכנות מקבלית או דומות ל thenewblack.ai וגם בתחום האיפור הוירטואלי

2. איך עשוי לשהפשיע עליך ועולם האופנה ?

3. חשוב על מוצר לתחום האופנה , טיפוח ויופי שזה יכול להתאים

עיצוב בגדים לילידם עם בינה מלאוכתית

שרטוט לעיצוב אופנתי

צור בגד עם הבגד שלך

תוכנות שולטות בתחום

Clo3D https://www.clo3d.com/en/

תרגיל כיתה 4 : (חזרה על חומר נילמד)

- צור קטלוג אופנה בעזרת בינה מלאוכתית

- צור דמות של גבר או אישה בעזרת בינה מלאכותית

- צור מספר אביזרי אופנה

- הלבש את התדמות – וצור מספר תמונות ובצע איפור וירטואלי בדמות אחת לפחות ועיצוב תכשיט

- צור ב CANVA סרטון קצר – המדובב בעזרת AVATAR שמסביר על הקולקציה

- צור מוסיקת רקע קלה בעזרת A.I

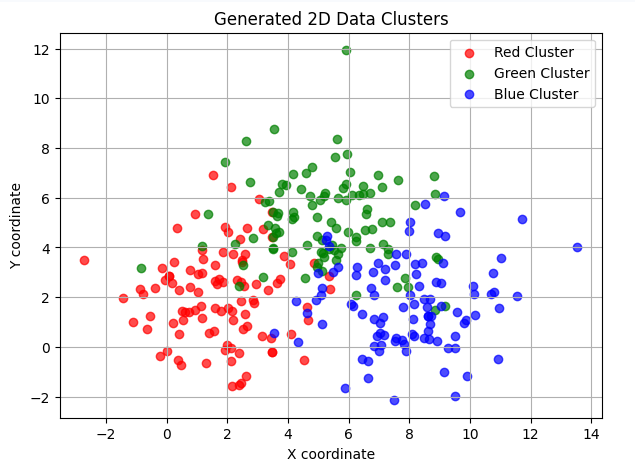

הרצה בקוד פייטון

מה זה MCP?

MCP – Model Context Protocol הוא פרוטוקול נפתח שפותח על ידי Anthropic (מפתחי Claude) בנובמבר 2024, שמטרתו להוות ממשק סטנדרטי בין מודלים של שפה (LLMs) לבין מערכות חיצוניות—כמו מסדי נתונים, שירותים חיצוניים או APIs. הפרוטוקול מאפשר לא רק שאילתות מידע אלא גם הפעלת פעולות, בתנאי הרשאה מוסכמת מראש ומבוקרת Reuters+15Wikipedia+15Zapier+15.

🏆 מי תומך ב‑MCP היום?

1. Anthropic

-

הפיתוח של הפרוטוקול ואחזקתו כרשת קוד פתוח (GitHub, SDKs בפייתון, TypeScript, C#, Java).

-

אחראית לפרסום הראשון של MCP ולתחזוק המרחב הפיתוחי The VergeWikipedia.

2. OpenAI

-

החלה לתמוך רשמית בפרוטוקול בחודש מרץ 2025, כולל במוצרי ChatGPT Desktop, OpenAI Agents SDK וה‑Responses API. נחשב שלב משמעותי באימוץ סטנדרט פתוח לאינטגרציה Wikipedia+1t3c.ai+1.

3. Google DeepMind / Gemini

-

באפריל 2025 אישר הדירקטור החברתי דמיס האסאבדיס ש‑Gemini תומך ב‑MCP ומגדיר אותו כ"תקן פתוח ל‑AI agentic era" The Verge+15Wikipedia+15agnt.one+15.

4. Microsoft

-

שותפה פעילה בתכנון ובפיתוח של MCP, בעיקר דרך אינטגרציה עם Semantic Kernel, Windows AI Foundry ו‑Copilot Studio. שחררה SDK מ‑C# והציגה מגבלות אבטחה כדי לאפשר אימוץ מוקפד ורחב Wikipedia+2The Verge+2Wikipedia+2.

5. חברות וכלים נוספים

-

חברות כמו Replit, Sourcegraph, Block, AWS, Codeium אימצו MCP כחלק מפיתוח כלי AI שנועדו לפעול כמודלים "עובדים עם כלים" באינטגרציה אחידה Zapier+4The Verge+4t3c.ai+4.

-

כלים כמו Zapier Agents, Nimble MCP Server, ו‑MCPR (Rust implementation) גם תשענו על הפרוטוקול בזכות תחזוקה קהילתית ופתוחה arXiv+9Zapier+9nimbleway.com+9.

🌍 קהילת משתמשים ודעות

בשדה הקוד הפתוח, קהילת מפתחים מגיבה בהתלהבות:

"Cannot believe that less than 2 months ago I thought I am working on some geeky niche… now MCP is mentioned everywhere."

"OpenAI has announced support for MCP in the Agents SDK… Microsoft have adopted it in their Copilot Studio too." Wikipedia+4Reddit+4Reddit+4

ינה מלאכותית, פרוטוקול MCP (Model Context Protocol) הוא תקן חדש יחסית (2024–2025) שנועד לאפשר ל־מודלי שפה גדולים (LLMs) לעבוד עם מידע חי, חיצוני ומעודכן, ולא רק על מידע שהם "זוכרים" מהאימון.

במילים פשוטות: MCP מאפשר ל-AI לשאול שאלות, לבצע פעולות, ולגשת לכלים ודאטה בזמן אמת, בצורה סטנדרטית, בטוחה וניתנת לניהול.

🧠 למה זה חשוב לעולם הבינה המלאכותית?

הבעיה:

מודלים כמו GPT או Claude מאומנים על מידע עד לנקודה מסוימת. ברירת המחדל שלהם היא "זיכרון סטטי".

הפתרון של MCP:

✅ מאפשר ל־AI לשלוח בקשה לנתונים חיים (כמו קובץ, API, מסד נתונים, כלי חיצוני)

✅ הפרוטוקול סטנדרטי, פתוח, מאובטח וניטרלי

✅ תומך בהבנת הקשר דינאמי: שיחות, קבצים, הקשרים עסקיים, מסמכים מרובים

📦 מבנה ההודעה של MCP (לעולם הבינה המלאכותית)

הפרוטוקול מבוסס על JSON-RPC 2.0 – קל ליישום ע"י מודלים ומפתחים כאחד.

המודל שולח הודעות בפורמט JSON, לדוגמה:

📥 קריאה למקור נתונים:

📤 הפעלת כלי (tool):

📡 קבלת תשובה:

🧩 מודלים שתומכים בזה

| מודל | תמיכה ב‑MCP |

|---|---|

| Claude (Anthropic) | ✅ מקור הפיתוח של MCP |

| GPT (OpenAI) | ✅ תומך ב-MCP דרך Agents SDK |

| Gemini (Google) | ✅ הוכרז באפריל 2025 |

| Copilot Studio (Microsoft) | ✅ תומך ב־MCP בכלים הארגוניים |

🛠️ שימושים אמיתיים לעולם ה-AI:

-

✍️ גישה למסמכים בזמן אמת – שליפת PDF, סיכום קבצים, השוואת חוזים

-

🔗 חיבור ל־API חיצוניים – שליחת בקשות HTTP או שימוש בכלי מותאם אישית

-

🧾 עבודה עם מסדי נתונים – קריאה/עדכון מידע חי

-

🤖 בניית סוכנים (Agents) – שמבצעים פעולות עם "עיניים פתוחות" לעולם החיצון

🔒 אבטחה ושליטה

-

המערכת מוודאת שה-AI לא ניגש לכל מקור מידע ללא הרשאה

-

ניתן לקבוע מה הוא רואה, מתי, ולכמה זמן

-

כל גישה משויכת ל־context sandbox

🧠 סיכום

MCP הוא הדרך לאפשר ל-AI לעבור מ-"מודל שזוכר דברים" ל-"מודל שפועל בעולם חי ודינאמי".

זהו שינוי פרדיגמה – מ-AI סטטי, ל־AI שמבין הקשר, מקבל החלטות, ופועל בעולם אמיתי.

MCP ועולם האופנה

קצת רקע תאיורטי – איך מפתחים בינה מלאוכתית ואפליקציה כזאת

פיתוח מערכת כמו TheNewBlack.ai – שהיא פלטפורמה לעיצוב בגדים באמצעות בינה מלאכותית (AI Fashion Designer) – מחייבת שילוב של מספר תתי-תחומים מתקדמים בעולם ה-AI, לצד פיתוח מערכות תוכנה, ממשקים ושרתים. הנה שלבים עיקריים לפיתוח מערכת כזו, כולל דגש על מודל ה-AI והאימון:

שלבים לפיתוח מערכת כמו thenewblack.ai

1. הגדרת מטרות המערכת והקונספט

-

מה המערכת עושה? (למשל: יצירת עיצוב בגדים על בסיס טקסט, התאמה למודל, תצוגה בזוויות שונות)

-

מי המשתמש? (מעצב, מותג, לקוח פרטי)

-

איזה אאוטפוט נדרש? (תמונה, מודל תלת-מימדי, דפוס טכני, מידות וכו')

2. איסוף ותיוג דאטה רלוונטי

סוגי דאטה:

-

תמונות של בגדים – אלפי תלבושות בסגנונות שונים

-

סקיצות ודגמים – דוגמות עיצוביות וסטיילינג

-

בגדים על מודלים אנושיים – נתוני פוזיציה, טקסטורה, גיזרה

-

מידע טקסטואלי – תיאורי אופנה, קטלוגים, תגיות, תיאור בגדים

מקורות:

-

דאטה פתוח (DeepFashion, Fashionpedia, Zalando datasets)

-

שותפויות עם מותגים

-

יצירה עצמית באמצעות סימולציות (CLO3D וכו')

3. אימון מודל בינה מלאכותית

מודלים מתקדמים מתאימים:

Text-to-Image Diffusion Models

-

לדוגמה: Stable Diffusion, DALL·E, Imagen

-

מייצרים תמונה על בסיס טקסט תיאורי (לדוגמה: “שמלת ערב אדומה עם שרוולים נפוחים בסגנון וינטג’”)

Fashion-Specific Fine-Tuned Models

-

כמו: Text2Fashion, FashionCLIP, VITON-HD, DressCode

-

מאפשרים שליטה טובה יותר על פריטים, מבנה גוף, התאמה לקטגוריה אופנתית

Text‑to‑Fashion?

זוהי מערכת Text-to-Image שמיועדת באופן מיוחד לעיצוב בגדים. למשל, קיימת יישום פיתוח בשם Text-to-Fashion-Image-Synthesis-using-GAN שמממש מחקר בנושא מה שנקרא "Efficiency of the Fusion Step in Language-Based Fashion Image Editing" Hugging Face+7GitHub+7Reddit+7.

כיצד המודל עובד:

-

משתמש ב‑GAN (Generative Adversarial Network) להעברת טקסט לדימוי אופנתי.

-

בשלב חיבור הדאטה (fusion step) ניתן לבחור בין שיטות כמו concat, FiLM, או low-rank Bilinear Pooling—כל אחת משפיעה על ביצוע והריאליזם של התמונה GitHub.

-

משולב שימוש ב‑FastText embedding ומשויכות למידות, טקסט ותמונה.

Conditional Image Generation

-

מאפשר שליטה בפרטי הפריט כמו צבע, בד, מרקם או גיזרה

4. תהליך אימון (Training Pipeline)

-

Preprocessing – ניקוי דאטה, סידור לפי קטגוריות, התאמת טקסט לתמונה

-

Tokenization – המרת הטקסט לפורמט שהמודל מבין (כמו CLIP tokenizer)

-

Augmentation – עיבוי הנתונים בעזרת וריאציות

-

אימון ראשוני – fine-tuning על Stable Diffusion למשל, על דאטה אופנתי

-

אימון רפינמנט (refinement) – אימון ספציפי לפי תתי-סגנונות, גזעים, תנוחות גוף

-

אימון מודל איכות – כמו aesthetic scorer לקביעת האם יצאה תמונה יפה וסטייליסטית

5. בניית ממשק משתמש (UI/UX)

-

עורך עיצוב: תיבת טקסט להנחיה יצירתית

-

הצגה: רקעים שונים, מודל שונה (מין, גיל, תנוחה)

-

אפשרות שמירה / ייצוא / שיתוף

-

חיבור לשירותי ענן (כמו Replicate או HuggingFace Spaces)

6. אינטגרציה טכנולוגית

-

Frontend: React/Vue/Next.js

-

Backend: Python, FastAPI, Flask

-

Image Generation API: HuggingFace, Replicate, או self-hosting של stable-diffusion

-

אחסון: AWS/GCP/Azure

7. בדיקות, שיפור מודל ו-Deployment

-

בדיקות איכות על יצירתיות, דיוק אופנתי, גיוון

-

AB testing עם משתמשים אמיתיים

-

שיפור המודל לפי feedback

-

הטמעה בשרתים מבוזרים לצורך זמינות והרחבה

העשרה – Stable Diffusion Prompt-based InPainting

ודות בינה מלאכותית – RB30-07 : עיצוב בגדים ואנימציה A.I