קורס יסודות בינה מלאכותית – RB30-01 : מבוא לבינה מלאכותית ולמידת מכונה

- קורס זה דורש שימוש בסיסי בשפה האנגלית , וחדו"א בסיסית , רקע בתיכנות כללי ממולץ

-

קישור תוכנת תרגום – יש להעזר לפי הצורך

-

https://translate.google.com/?sl=iw&tl=en&op=translate

-

נידרש : חשבון אימייל Gmail וסיסמא להמשך הקורס

-

מדיה סינתטית ודייפ פייק :

1.1 שימוש ב DEEP FAKE להורות לכל הכוחות באוקריינה להניח את נישקם

1.1. שימוש ב HYPER MEDIA ולדמיר פוטין

בקצרה :

בתעשייה (שימוש חיובי) זה לרוב נקרא:

- Synthetic media (מדיה סינתטית)

- AI-generated content / AI-generated media (תוכן/מדיה שנוצרו ב-AI)

- VFX / Digital compositing (כשזה בעולם קולנוע/אפקטים)

- Voice synthesis / TTS (כשזה קול)

- Dubbing / Localization (דיבוב/לוקליזציה)

- Digital human / Virtual avatar (דמות וירטואלית)

כשזה לשימוש הונא/שלילי זה לרוב נקרא:

- Deepfake fraud / Deepfake scam (הונאת דיפ־פייק)

- Impersonation (התחזות)

- Identity fraud / Identity theft (מרמת זהות/גניבת זהות)

- Social engineering (הנדסה חברתית)

- Synthetic identity / Synthetic impersonation (זהות/התחזות סינתטית)

- Disinformation / Misinformation (דיסאינפורמציה/מידע מטעה)

- Forged media / Manipulated media (מדיה מזויפת/מניפולטיבית)

כלל אצבע פשוט:

- חיובי: יש הסכמה + גילוי נאות + מטרה יצירתית/שירותית.

- הונאה: אין הסכמה ו/או מסתירים שזה AI כדי לגרום למישהו להאמין שזה אמיתי ולבצע פעולה (כסף/מידע/פגיעה).

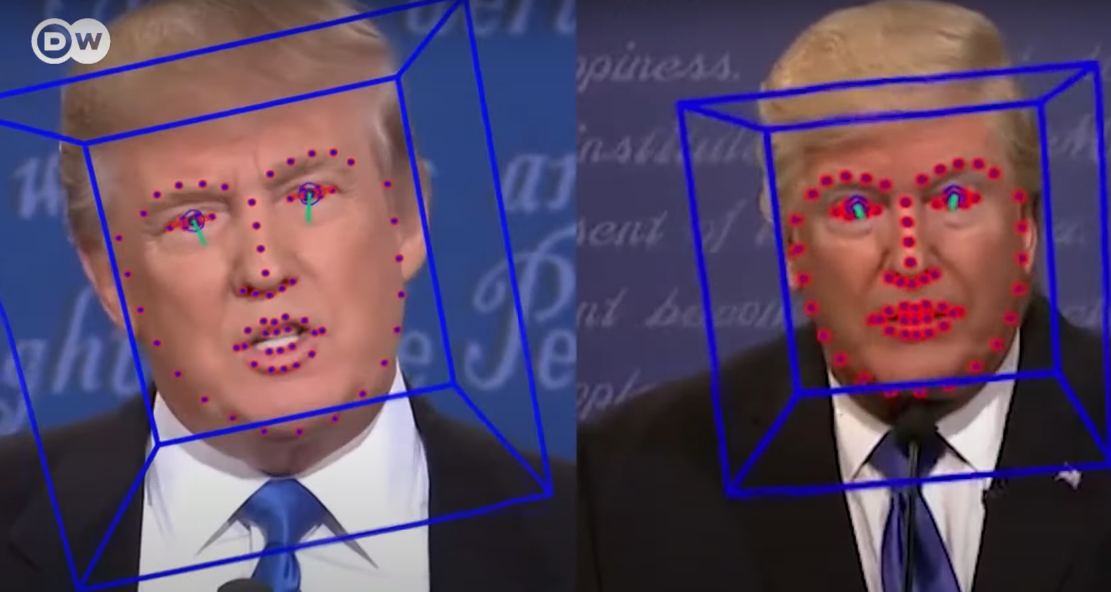

דיפ־פייק (Deepfake) הוא וידאו/אודיו/תמונה שנוצרו או נערכו בעזרת בינה מלאכותית (למידה עמוקה) כך שנראים אמיתיים, למרות שלא התרחשו כך במציאות.

דוגמאות נפוצות:

-

החלפת פנים בווידאו כדי שייראה שאדם אחר מופיע בו.

-

סנכרון שפתיים: לגרום לאדם בסרטון “לדבר” טקסט שלא אמר.

-

חיקוי קול (Voice cloning) כדי שישמע כמו אדם אמיתי.

-

יצירת תמונה/וידאו מאפס של אדם או אירוע שלא קרה.

Dataset = אוסף של הרבה דוגמאות של מידע, שממנו הבינה המלאכותית “לומדת”.

כמו מחברת עם הרבה דפים:

- בכל דף יש דוגמה אחת.

- לפעמים כתובה גם התשובה הנכונה ליד הדוגמה.

דוגמאות:

- תמונות של חתולים וכלבים + ליד כל תמונה כתוב “חתול” או “כלב”.

- טבלה של אנשים (גיל, גובה, משקל) + ליד כל שורה כתוב “בריא/לא”.

- סרטונים + ליד כל סרטון כתוב “ריקוד/דיבור/ריב”.

למה זה חשוב?

כי בלי Dataset, לבינה מלאכותית אין “חומר לימוד” כדי ללמוד ולהצליח לנחש נכון.

אז מה אמתי עכשיו ו A.I ?

נוסף ….

1.1 .תרגיל כיתה

1.2 רשום 7 יתרונות ו 7 חסרונות לשימוש ב DEEP FAKE ו HYPER MEDIA

1.3 כיצד אפשרי להתמודד מול סכנות אלו

1.4 מה ההשלכות על הדור הצעיר בני 4 ומטה שמעולם לא הכירו מציאות אחרת – איך ידעו להבדיל בין מציאות ל A.I אמת ושקר

2.1 דייפ פייק : קסם או אומנות או בינה מלאכותית ?

אז מה דעתכם עכשיו ?

כמה זה מסוכן ?

2.2 Cybercrime and Internet Fraud –

פשעי סייבר והונאת אינטרנט בעזרת בינה מלאכותית

מוכרים לנו מוצר הוא אמתי או שקר ?

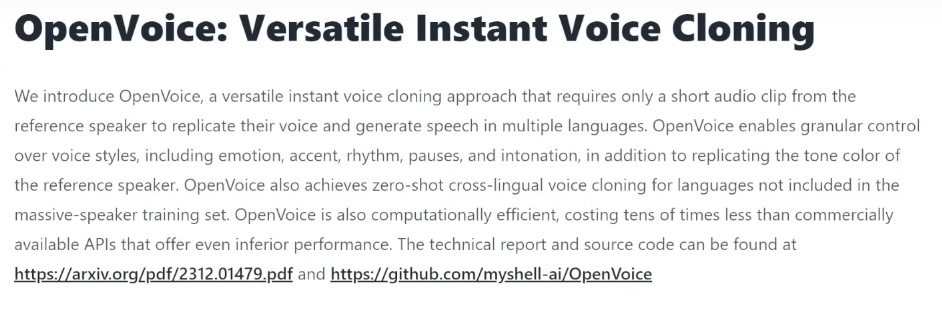

2.2.1 VOICE CLONING

מהו VOICE CLONING ?

Voice cloning (שכפול קול) הוא תהליך שבו מערכת בינה מלאכותית לומדת את המאפיינים הייחודיים של קול של אדם (טון, גובה, מבטא, קצב דיבור, צבע קול) ומייצרת דיבור חדש שנשמע כמו אותו אדם, גם אם הוא אומר משפטים שמעולם לא הקליט.

איך זה עובד בקצרה:

- נותנים למודל דוגמאות קול (לפעמים דקות בודדות, לפעמים יותר).

- המודל יוצר “ייצוג” של הקול (voice embedding).

- אחר כך מזינים טקסט, והמערכת מפיקה אותו בקול הדומה.

שימושים לגיטימיים:

- דיבוב וקריינות (למשל לשחזור קול לאחר פגיעה רפואית, אם יש הקלטות עבר ובהסכמה).

- משחקים/סרטים/אודיו-בוקס.

- תמיכה בשפות שונות עם אותו “קול”.

סיכונים מרכזיים:

- התחזות והונאות (שיחות “נשמע כמו בן משפחה”).

- זיוף ראיות קוליות/דיפ-פייק.

- פגיעה בפרטיות אם עושים בלי הסכמה.

התופעה מסוכנת בעיקר כי “קול” נתפס אצל אנשים כהוכחה חזקה לזהות, אבל היום אפשר לזייף אותו מהר ובעלות נמוכה. רמת הסיכון בפועל תלויה בתרחיש.

מה הכי מסוכן בפועל

-

הונאות טלפון למשפחה/עובדים

“אבא/אמא תעביר כסף עכשיו”, “נחטפתי”, “תאשר קוד חד־פעמי”. -

התחזות למנהלים (BEC)

שיחה קצרה לעובד כספים כדי לשנות פרטי העברה/ספק. -

עקיפת תהליכים שמסתמכים על קול בלבד

מוקדים טלפוניים, אימות לקוח, אישור פעולה “בשיחה”. -

סחיטה/פגיעה בשם טוב

הקלטה מזויפת שמציגה אמירה בעייתית.

כמה זה מסוכן (במילים פשוטות)

-

לא “סוף העולם”, אבל זה כלי שמעלה מאוד את שיעור ההצלחה של הונאות, כי הוא שובר את האינטואיציה האנושית.

-

הסיכון הכי גבוה כשיש לחץ זמן, כסף, או שימוש בקודי OTP/אישורים טלפוניים.

איך להתמודד בצורה הכי יעילה (פרקטי)

א. בבית ובמשפחה (הכי חשוב)

-

“מילת קוד” משפחתית: מילה/משפט שלא יופיע בשיחה אמיתית של נוכל. בלי זה לא מבצעים שום פעולה.

-

כלל “ניתוק וחזרה”: תמיד מנתקים ומתקשרים למספר שמור באנשי קשר (לא למספר שממנו התקשרו).

-

לא מעבירים כסף/קוד OTP בשיחה נכנסת. נקודה.

ב. בעסק/ארגון

-

תהליך אישור כפול לכל פעולה כספית:

שיחה חוזרת למספר ידוע + אישור כתוב בערוץ שני (מייל ארגוני/מערכת/חתימה דיגיטלית). -

“אין חריגים בלחץ”: שינוי פרטי בנק/ספק רק אחרי אימות דרך מערכת קיימת.

-

הדרכת עובדים על “תרגילי לחץ” (דחיפות, סודיות, פחד).

ג. במוקדי שירות/אימות לקוחות

-

לא להסתמך על קול בלבד (voice biometrics בלבד לא מספיק).

-

להוסיף אימות רב-גורמי: אפליקציה, סיסמה/פין, שאלות דינמיות, או חתימה דיגיטלית.

-

מנגנוני “liveness” וקונטקסט: שאלות בזמן אמת שמצריכות פעולה/תגובה לא צפויה (עדיין לא מושלם, אבל מעלה קושי).

ד. זיהוי זיוף בזמן אמת (סימנים נפוצים, לא תמיד קיימים)

-

אינטונציה “שטוחה” או לא טבעית, נשימות לא עקביות, הדגשה מוזרה של מילים.

-

בקשה חריגה + לחץ זמן (“עכשיו”, “דחוף”, “אל תגיד לאף אחד”).

-

הימנעות משאלות פשוטות (“מה שם הכלב?”, “איפה נפגשנו אתמול?”) או תשובות כלליות.

מקרים פה בישראל

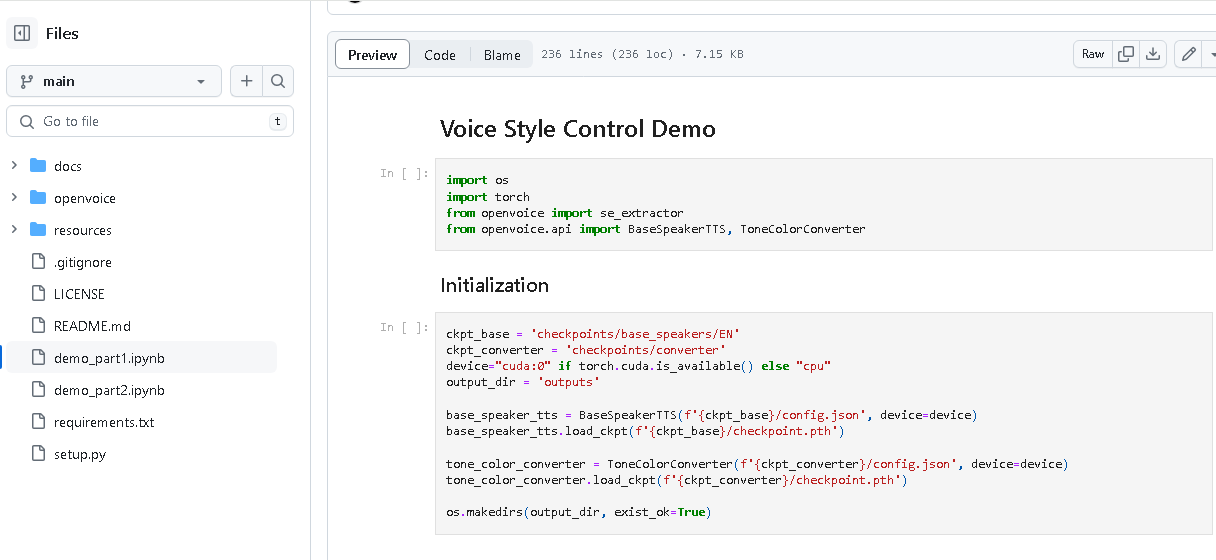

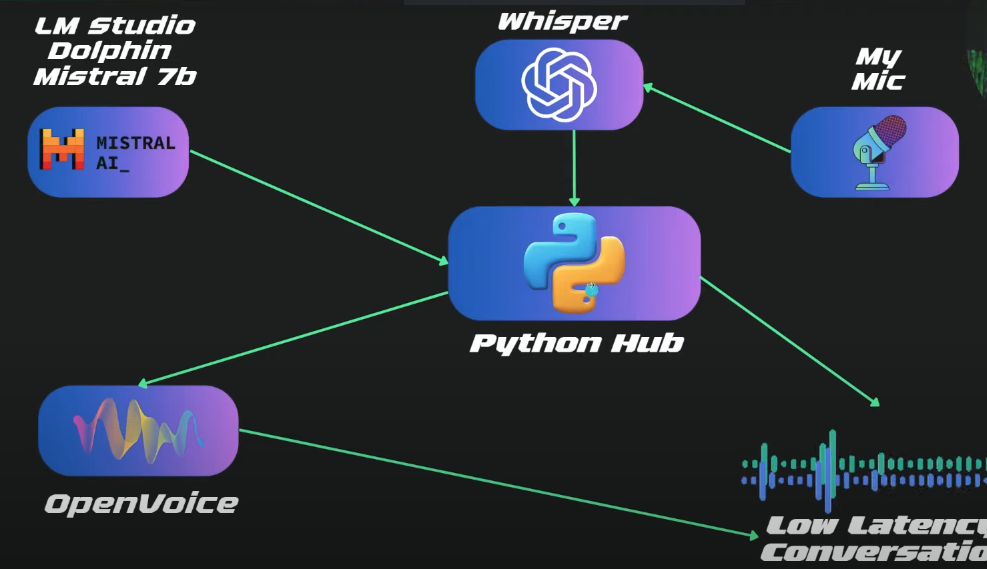

2.2.2 Deep Fake Audio – real-time voice cloning

2.2.2.1.1 קישור לאתר : https://research.myshell.ai/open-voice

2.2.2.1.2 קישור לקוד מוקור : https://github.com/myshell-ai/OpenVoice

הסבר איך אפשר להריץ A.I CLONING

https://youtu.be/1ec-jOlxt_E?t=71

איך מיצריים הודעה בקול של מישהו אחר מוקלטת או בזמן אמת

https://youtu.be/1ec-jOlxt_E?t=241

2.2.3.תרגיל כיתה

2.2.3.1 התחבר לאתר אשר מפכיל TEXT TO VOICE מבוסס על מנוע – בינה מלאכותית

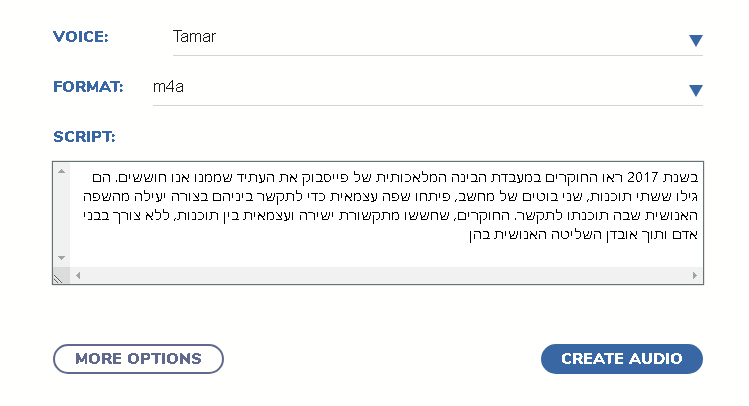

https://www.narakeet.com/languages/hebrew-text-to-speech/#trynow העתק והדבק את הטקסט הבא

בשנת 2017 ראו החוקרים במעבדת הבינה המלאכותית של פייס בוק את העתיד שממנו אנו חוששים. הם גילו ששתי תוכנות, שני בוטים של מחשב, פיתחו שפה עצמאית כדי לתקשר ביניהם בצורה יעילה מהשפה האנושית שבה תוכנתו לתקשר. החוקרים, שחששו מתקשורת ישירה ועצמאית בין תוכנות, ללא צורך בבני אדם ותוך אובדן השליטה האנושית בהן, ניתקו את התוכנות התבוניות לחלוטין.

זה היה פרק נוסף בתסריט האימים שהאנושות חוששת ממנו. מכונות שעובדות ביחד, באופן עצמאי לחלוטין.

בינה מלאכותית או אינטליגנציה מלאכותית היא ענף במדעי המחשב שמנסה להקנות למחשבים את היכולת לחשוב באופן שבו חושב המוח האנושי. הבינה האנושית היא שונה מזו של המחשב בדרך שבה היא מתרחשת, אבל היא הולכת ומתקדמת לחיקוי החשיבה האנושית.

הדבק את הטקסט הבא : ותן לבינה מלאכותית לדובב אותו לעברית

שנה אותו והשמע אותו שוב לתמר

SVFR, or Stable Video Face Restoration, is an AI-driven framework developed by Tencent and Xiamen University

SVFR תומכת גם בהמרת וידאו משחור-לבן לצבע (Colorization), בנוסף לשיפור חדות ואיכות הפנים. המערכת משלבת טכנולוגיות מתקדמות לשחזור צבעים טבעיים ולתיקון עיוותים בתמונות ובסרטונים ישנים.

דוגמת קוד בפייתון לצביעת וידאו בשחור-לבן באמצעות AI

ניתן להשתמש במודל כמו DeOldify, שהוא רשת נוירונים מבוססת GAN לצביעה חכמה של וידאו.

Training on Large Datasets

The GAN is trained on millions of real, full-color images that include grass, sky, trees, skin tones, etc.

During training, it learns statistical patterns:

- Grass is usually green.

- The sky is often blue.

- Tree trunks are brown.

When presented with a black-and-white image, the model predicts the most likely colors based on what it has learned.

https://colab.research.google.com/github/jantic/DeOldify/blob/master/VideoColorizerColab.ipynb#scrollTo=MZWDC5etujVw

פשעי סייבר והונאת אינטרנט בעזרת בינה מלאכותית

2.2.3 שהבוס מתקשר ונותן פקודה מה עושים ?

המקרה הראשון : העברת כסף

FALSE JOANNES הונאת בעזרת בינה מלאכותית – VOICE CLONING SOFTWARE

3. מודל G.A.N – בבינה מלאכותית – חומר תיאורטי ורקע מדעי

GAN = Generative Adversarial Network (2014)

בעברית: רשת יצירתית יריבה (או: רשת גנרטיבית אדברסרית)

G = Generative = “יוצר” (מייצר דוגמאות חדשות)

A = Adversarial = “יריבי/מתחרה” (באימון יש תחרות)

N = Network = “רשת” (רשת נוירונים)

מי המציא ומתי

- הוצג לראשונה ע״י Ian J. Goodfellow ושותפיו. (arXiv) 2014

- הופיע גם בכנס NeurIPS (NIPS) 2014 תחת השם “Generative Adversarial Nets”. (papers.nips.cc)

ב־GAN יש שתי בינות מלאכותיות: יוצר ו־בודק.

כך זה עובד בצורה פשוטה, עם “ציון” (ערך התאמה):

- יש Dataset

מאגר גדול של תמונות אמיתיות (למשל פרצופים אמיתיים). - היוצר מייצר תמונה חדשה

הוא מתחיל מ”רעש” (מספרים אקראיים) ומוציא תמונה. - הבודק נותן ציון

הבודק ראה הרבה תמונות אמיתיות מה־Dataset, אז הוא למד “איך נראה אמיתי”.

הוא מקבל את התמונה החדשה ונותן ערך בין 0 ל-1 (או 0%–100%):

- 0 = בטוח מזויף

- 1 = בטוח אמיתי

- אם הציון נמוך – היוצר מתקן

נניח שהבודק נתן 0.30 (30%).

אז היוצר מקבל “משוב” (איך לשנות פיקסלים/תכונות) כדי לעלות בציון בפעם הבאה. - אם הציון גבוה – זה אומר שהתמונה “עוברת”

נניח שהצבת סף כמו 0.85 (85%).

אז מבחינת הבודק, התמונה כבר נראית מספיק כמו תמונות מה־Dataset.

חשוב לדייק:

- בזמן אימון אמיתי, לא עושים “אישור” קשיח של 85% לכל תמונה.

- מה שקורה בפועל: הבודק תמיד נותן ציון, והיוצר תמיד משתפר כדי להעלות את הציון.

- הסף (כמו 85%) הוא דרך טובה להבין את הרעיון, או להשתמש בו בבדיקת איכות אחרי אימון.

וידאו (פריים-פריים)

- בווידאו אפשר להפעיל את זה על כל פריים (תמונה-תמונה).

- אבל כדי שווידאו ייראה אמתי צריך גם עקביות בין פריימים (שפנים/אור/פרטים לא “יקפצו”).

לכן הרבה מערכות מוסיפות עוד בדיקות/מנגנונים כדי לשמור על רציפות בזמן.

תמונה בודדת

- זה אותו עיקרון: היוצר מייצר, הבודק נותן ציון מול מה שלמד מה־Dataset, והיוצר משתפר עד שהתמונה נראית אמיתית.

למה קשה לזהות זיוף שנוצר ע״י GAN

- האימון מכוון “לעבוד על” גלאי זיופים: המודל היוצר משתפר בדיוק מול מודל שמנסה לזהות זיוף, ולכן לומד לחקות דפוסים שמבלבלים גם בני אדם. (arXiv)

- הוא לומד סטטיסטיקה של העולם (מרקמים, תאורה, רעש מצלמה, פרופורציות) מתוך המון דוגמאות, ולכן הפלט נראה טבעי. (arXiv)

- המוח האנושי משלים פרטים חסרים: אפילו אם יש פגמים קטנים, אנחנו “מחליקים” אותם, במיוחד בוידאו קצר/דחוס. (זה עיקרון תפיסתי כללי).

3.1 איך DEEP FAKE בעצם מפותח ולמה כל כך קשה לזהות אותו ולמה יהיה יותר ויותר קשה בעתיד

איך לזהות DEEP FAKE בינה מלאוכתית ?

slips גליצים של תמונה אחר תמונה

4 תרגיל כיתה

4.1 כתוב 3 דוגמאות איך אפשר להגן מפני הונאות של קול וידאו ועוד למשל בשיחת טלפון מזוייפת

4.2 כתוב לכל דוגמא איך לדעתך אפשר להגן ולהתמודד מול אותה תקיפה

4.3 נהלו דיון בכיתה

5. Digital Resurrection (תחייה דיגיטלית) – לדבר עם "המתים"

התחום נקרא בדרך כלל:

-

Digital Resurrection (תחייה דיגיטלית) – יצירת ייצוג דיגיטלי של אדם שנפטר (קול/וידאו/אווטאר) כך שנראה שאפשר “להחזיר” אותו.

-

Grief Tech (טכנולוגיות אבל) – שם תעשייתי/שוקי לכלים שמאפשרים קשר/שיחה עם “גרסה דיגיטלית” של הנפטר.

-

Griefbot / Deadbot / Deathbot – “בוט” שמדמה את האדם שנפטר לשיחה (טקסט/קול/אווטאר).

איך נעשה מה נידרש ?

כדי “להחזיר” אדם שנפטר לתקשורת (טקסט/קול/וידאו), בונים מערכת מכמה רכיבים. זה מה שנדרש ואיך זה נעשה בפועל:

מה נדרש

-

נתונים של האדם (הכי חשוב)

-

טקסטים: הודעות, מיילים, פוסטים, מסמכים, תמלולים.

-

קול: הקלטות נקיות יחסית (שיחות, סרטונים, הודעות קוליות).

-

תמונות/וידאו: לצורך “אווטאר” וידאו (פנים, הבעות, זוויות).

-

הרשאה וזכויות

-

הסכמה מראש של האדם (אם קיימת) או אישור משפטי/משפחתי לפי החוק המקומי.

-

זכויות יוצרים/פרטיות על חומרים (הקלטות, תמונות).

איך זה נעשה (פייפליין טיפוסי)

-

איסוף וניקוי נתונים

מסדרים את כל הטקסטים לפי זמן ונושאים, מסירים מידע רגיש, מתקנים שגיאות, ומייצרים “פרופיל” שפה: סגנון כתיבה, ביטויים, הומור, דעות כלליות (אם בוחרים לכלול). -

“מוח שיחה” בטקסט (LLM + פרסונה)

-

בוחרים מודל שפה (LLM).

-

נותנים לו “פרומפט פרסונה” שמגדיר מי האדם, איך הוא מדבר, גבולות (למשל לא להמציא עובדות אישיות).

-

מוסיפים מנגנון זיכרון מבוסס מסמכים: RAG (שליפה מהמאגר). זה חשוב כדי שהתשובות יתבססו על מה שהאדם באמת אמר/כתב, ולא רק ימציא.

-

-

קול (Voice Cloning + TTS) אם רוצים לדבר בקולו

-

מאמנים/מתאימים מודל שמפיק דיבור בקול דומה.

-

מינימום מעשי: לפעמים מספיקות דקות, אבל לאיכות טובה ואמינות צריך יותר, ורצוי מגוון רגשי וסביבות.

-

מוסיפים שליטה בקצב, טון, הפסקות נשימה.

-

-

וידאו/אווטאר (אם רוצים “פנים מדברות”)

יש שתי גישות נפוצות:-

Lip-sync: לוקחים תמונה/וידאו ומסנכרנים שפתיים לפי האודיו שנוצר.

-

Avatar מלא: מודל שמייצר פנים/ראש מדברים בצורה יותר חיה.

כאן צריך הרבה וידאו/תמונות איכותיות כדי להיראות דומה ולא “מוזר”.

-

-

תזמור המערכת בזמן אמת

זרימה אופיינית:

משתמש שואל → LLM מייצר תשובה (עם שליפה מהמאגר) → אם צריך קול: TTS בקול המדומה → אם צריך וידאו: אווטאר מסנכרן שפתיים → מציגים למשתמש. -

בקרת איכות והגנות

-

“מצב נאמנות”: להגביל תשובות רק למה שנמצא במאגר (“אין לי מידע על זה”).

-

סימון תמידי שזה AI.

-

חסימת הונאה: לא לתת “אישורים”, בקשות כסף, התחזות רשמית, וכו’.

-

מה מינימום כדי שזה יעבוד “סביר”

-

לצ’אט טקסטואלי בסיסי: אוסף גדול יחסית של טקסטים (מאות/אלפי הודעות) + RAG.

-

לקול משכנע: הקלטות קול נקיות, רצוי מגוון (לא רק משפטים קצרים).

-

וידאו משכנע: הרבה חומר וידאו/תמונות, אחרת התוצאה לרוב תיראה לא טבעית.

ומה קורה שאין בכלל מידע מוקלט עד כמה רחוק בינה מלאכותית יכולה ללכת לשחזר ?

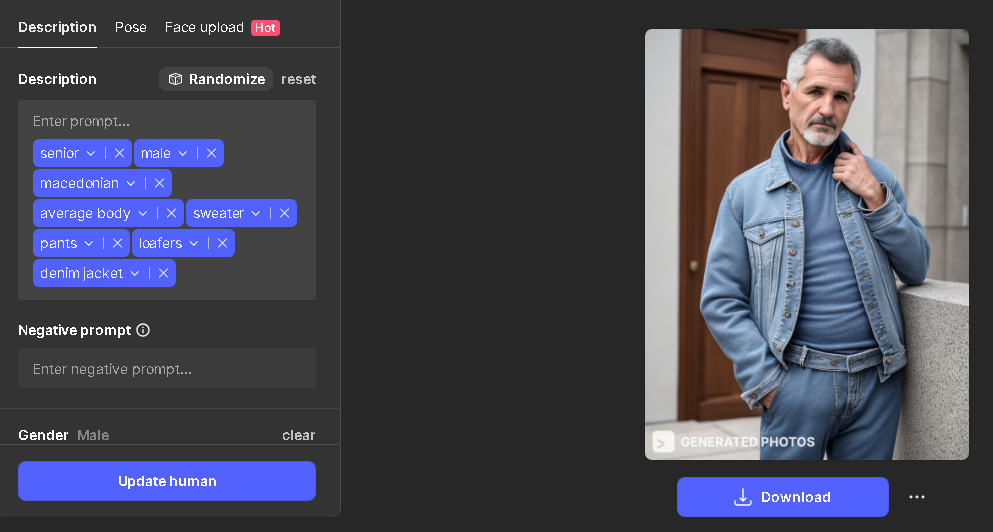

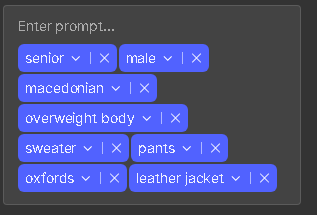

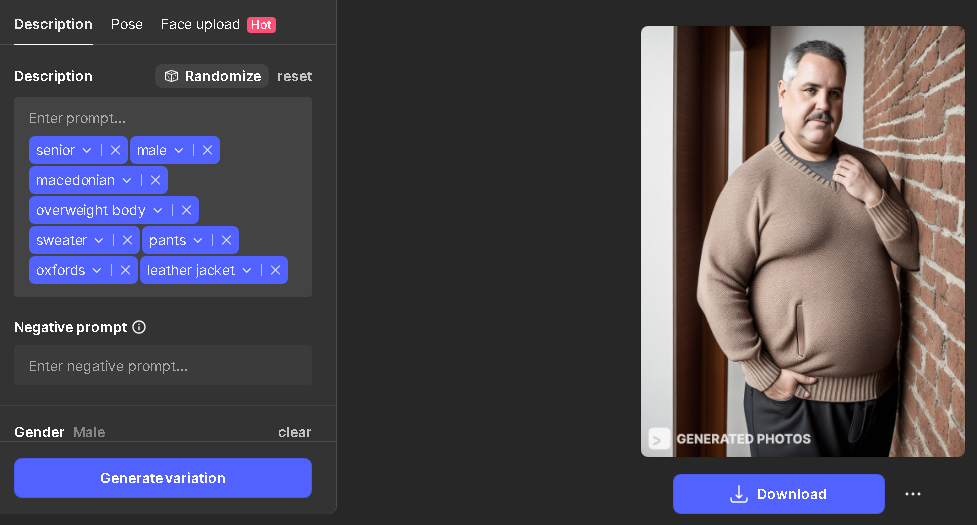

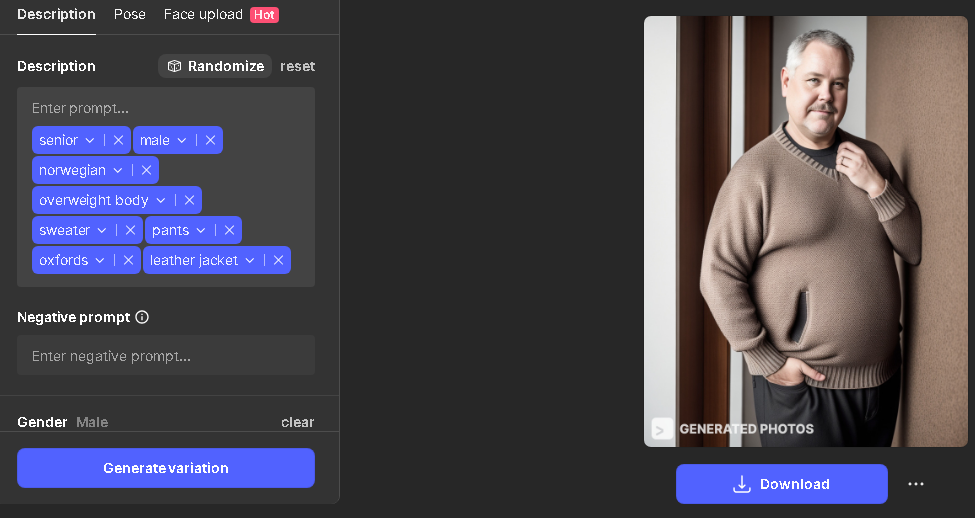

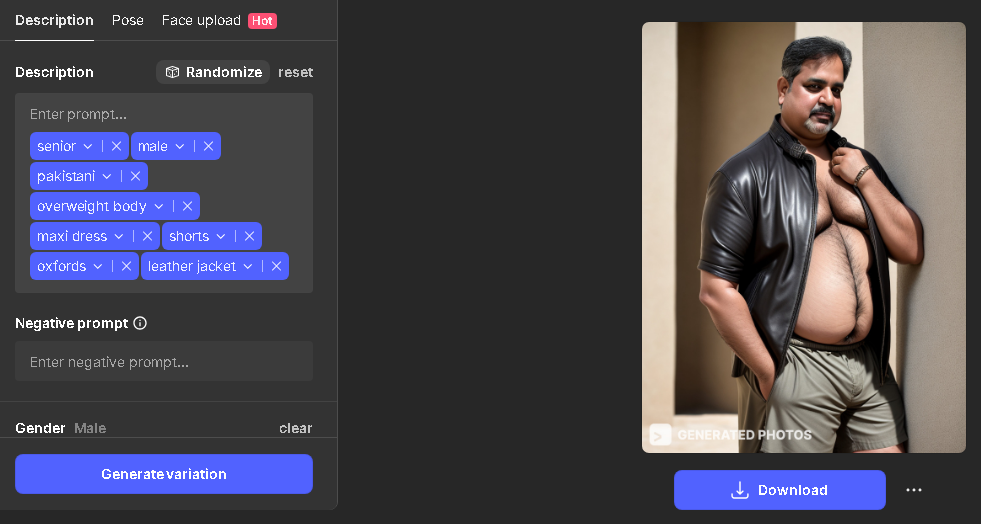

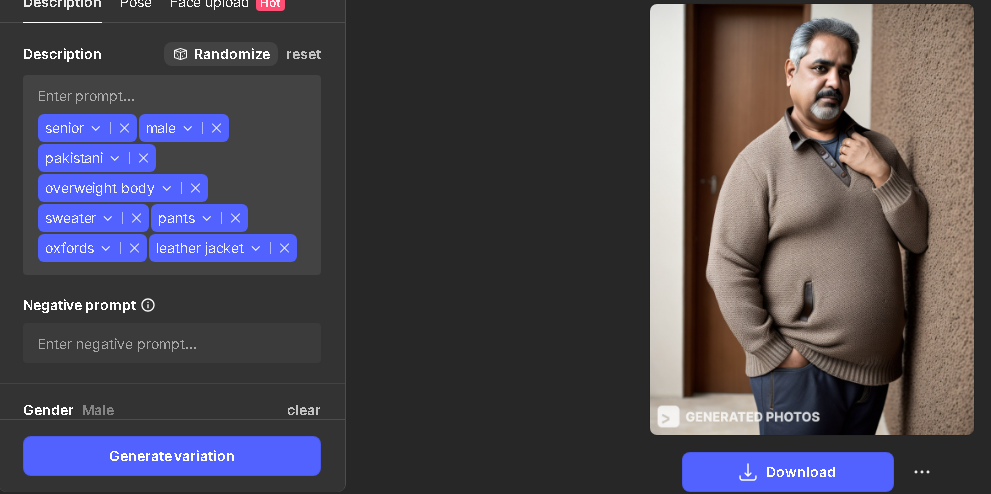

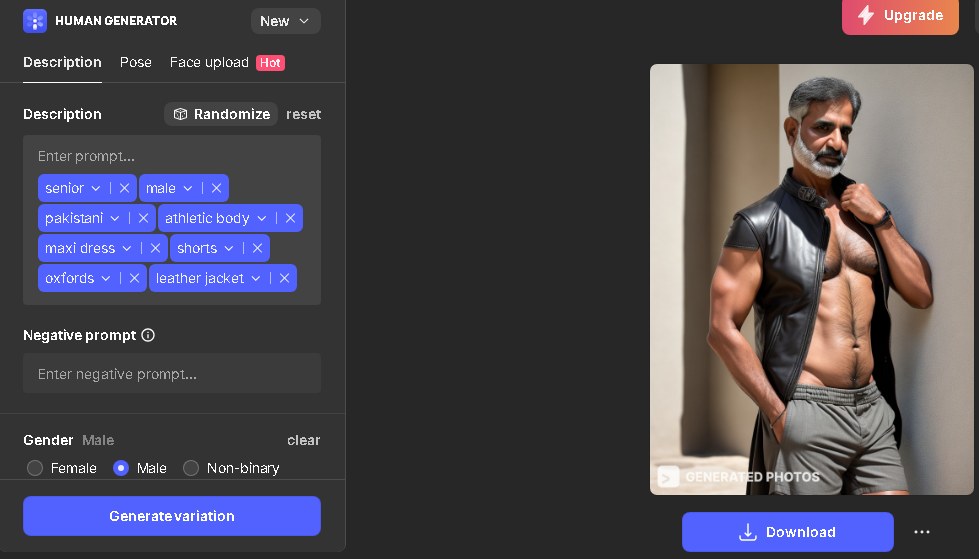

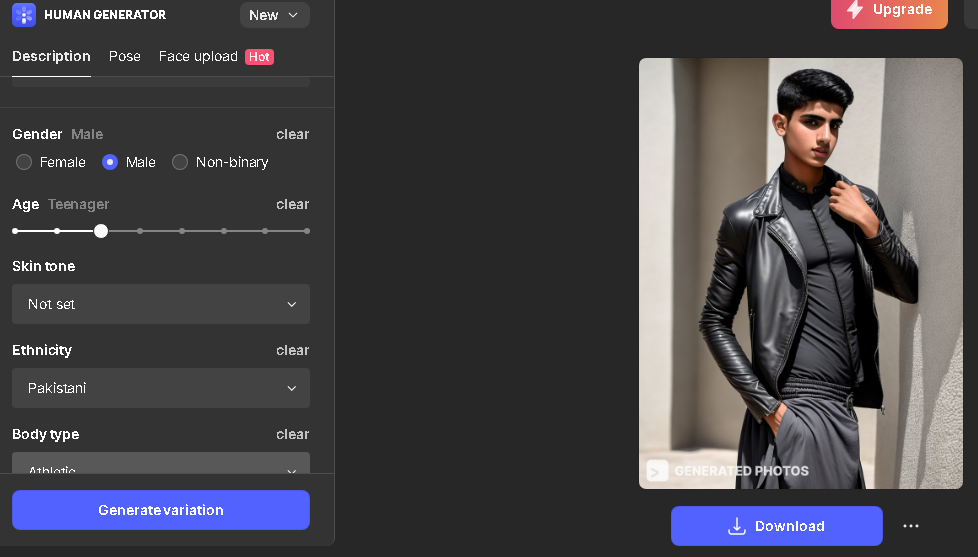

3. יצרת אנשים וירטואלים ומנפולציה וסימולציה של תמונות

https://generated.photos/human-generator

3.1 שינוי פרמטרים –

3.2

3.4 התוצאה

![]()

שינוי גיל לגיל 16 :

4. תרגיל כיתה

4.1 תרגיל כיתה יצרת דומו וירטואלית באתר https://generated.photos/human-generator

4.2 צור דמות וירטואלית

4.3 שנה את הדמות למשקל עודף

4.4 שנה את גיל הדמות

4.5 שה את ביגוד הדמות

4.6 צור את הדמות מחדש

5. יצירת תמונה עם בינה מאלכותית – האם בינה מלאכותית יכולה לדמיין

5.1.1 יצירת תמונה על ידי בינה מלאכותית על ידי תיאור מילולי

שימוש בגוגל טרנסלאיישן

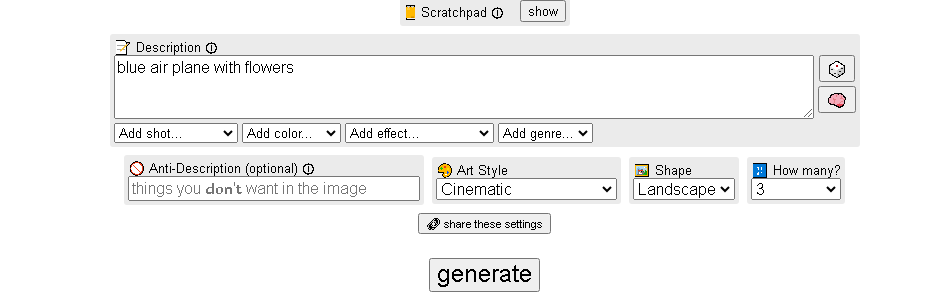

5.1 יצירת תמונה מטוס כחול עם פרחים

5.2 דוגמה נוספת שהיא דימיונית לגמרי (האם בינה מלאכותית יכולה לדמיין )

5.3 תרגיל כיתה

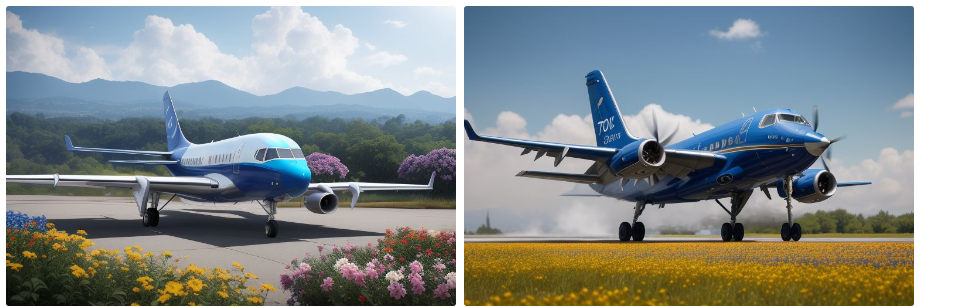

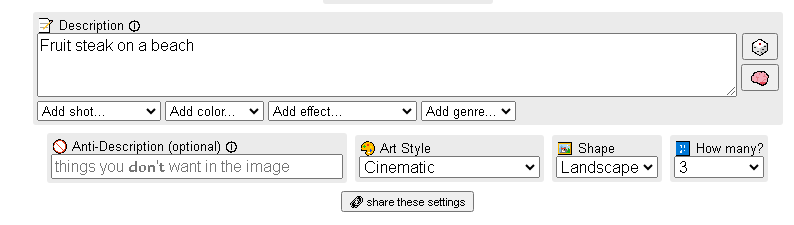

5.3.1 היכנס לקישור https://perchance.org/ai-photo-generator העזר בתוכנית תרגום לפי הצורך

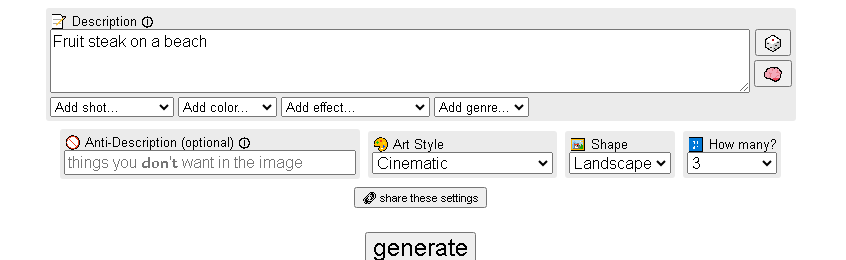

5.3.2 צורך את התמונה הבאה כתוב משפט זה Fruit steak on a beach , לחצו כפתור ליצור תמונות ![]()

5.3.3 מה התוצאה שקיבלת ?

5.3.4 צור תמונה חדשה –

6. בינה מלאכותית מטיסה מטוסי קרב

6.2 בינה מלאכותית קרבות אויר אויר אדם מול מכונה

6.3 איך מלמדים בינה מלאכותית להטיס , ואיך מלמדים אותה להילחם ( Reinforcement Learning )

6.4 איך מלמדים בינה מלאכותית להטיס רחפן RACER

7. שפת פייתון – Python

6.1 סיבות ממודע משתמשים בשפת תכנות פייתון לבינה מלאכותית

פייתון הוא שפת תכנות פופולרית שנמצאת בשימוש רחב, גם בתחום של הבינה המלאכותית. ישנם מספר סיבות לכך:

- קלות בלמידה ושימוש: פייתון היא שפה נוחה ללמידה ולשימוש, והיא מצוינת עבור מתחילים ולמתקדמים כאחד. זה מהווה יתרון גדול כאשר מבוצעות פעולות של הבנה מלאכותית, המעורבות בעיקר בתהליכי ניתוח נתונים ולמידת מכונה.

- קהילת פיתוח פועלת: פייתון נהנית מקהילת פיתוח פועלת ופתוחה. ישנם מספר ספריות וכלים מוכנים שנבנו בפייתון עבור מגוון רחב של מטרות בתחום הבינה המלאכותית, וכן קיימות קהילות פעילות שמפתחות פרויקטים בתחום.

- תמיכה בספריות וכלים מתקדמים: ישנם כמויות רבות של ספריות וכלים מתקדמים עבור פייתון שנועדו לתמוך בפיתוח של פרויקטים בתחום הבינה המלאכותית. לדוגמה, TensorFlow ו-PyTorch הן שתי ספריות פופולריות ללמידת מכונה ורשתות עצבים עם פייתון.

- מתאימות למגוון רחב של משימות: פייתון מתאימה למגוון רחב של משימות בתחום הבינה המלאכותית, כולל עיבוד שפה טבעית, ראיה ממוחשבת, גישות למידה חסרות תפריט, ועוד. זה מאפשר לפיתון לשמש ככלי ראשי בעיקר בתחום זה.

בסיכום, פייתון משמשת בתחום הבינה המלאכותית בגלל נוחות השימוש, התמיכה הרחבה, והקהילה הפעילה שמספקת כלים וספריות מתקדמים לפיתוח פרויקטים בתחום זה

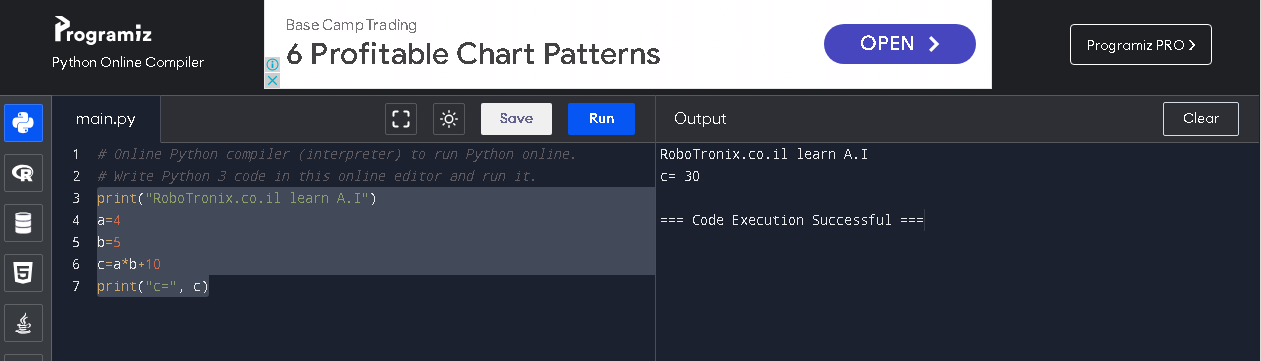

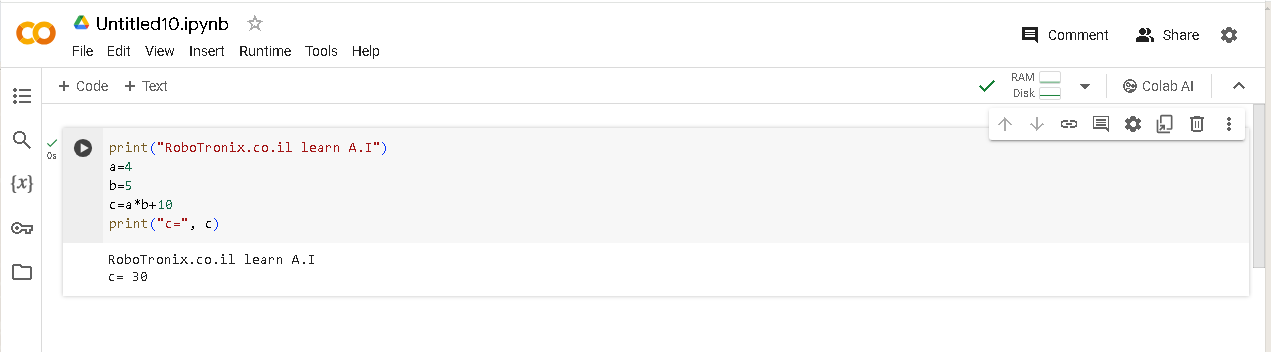

7.1 איך כותבים תוכנה בשפת פייתון ?

7.2 קיושר לאדיטור \ קומפייל – יש הרבה מאוד סוגים

https://www.programiz.com/python-programming/online-compiler/

|

1 2 3 4 5 |

print("RoboTronix.co.il learn A.I") a=4 b=5 c=a*b+10 print("c=", c) |

colab

7.3 תרגיל כיתה עבודה בזוגות

והרץ בפייתון וגלה מה עושה כל תכונה גזור והדבק את קוד התכונה

השתמשו בקישור הבא https://www.programiz.com/python-programming/online-compiler/

7.3.1

|

1 |

print("Hello, World!") |

7.3.2

|

1 2 |

greeting = "Welcome!" print(greeting) |

7.3.4

|

1 2 |

result = 7 + 3 print(result) |

7.3.5

|

1 2 3 |

age = 18 if age >= 18: print("You are an adult.") |

7.3.6

|

1 2 |

colors = ["red", "green", "blue"] print(colors[0]) |

7.3.7

|

1 2 |

colors = ["red", "green", "blue"] print(colors[0]) |

7.3.8

|

1 2 |

for i in range(3): print(i) |

7.3.9

|

1 2 3 4 5 |

number = 5 if number > 10: print("The number is greater than 10") else: print("The number is not greater than 10") |

7.3.10

|

1 2 3 4 |

count = 0 while count < 3: print(count) count += 1 |

7.3.11

|

1 2 |

name = input("What is your name? ") print("Hello, " + name) |

https://pika.art/my-library

לסיום רובוט צריך להיות גם נשמה